Apache TinkerPop, Neo4J, Amazon Neptune und TigerGraph Graphdatenbanken im Vergleich

Der Markt für Graphdatenbanken blüht und wächst, denn die Nachfrage hinsichtlich der Analyse vernetzter Daten steigt rasch. Doch der IT-Nutzer fragt sich, welche Graphdatenbank die leistungsfähigste ist und sich mit ihren Funktionen für ihn am besten eignet.

Anbieter zum Thema

Dieser kleine Überblick untersucht verbreitete Graphdatenbanken, die inzwischen alle in der Cloud betrieben werden können: Neo4J, Amazon Neptune und Apache TinkerPop. Ein Newcomer in der Auswahl ist TigerGraph.

Apache TinkerPop

Apache TinkerPop ist ein Open-Source-Projekt. Die Veröffentlichung der ersten Version der Graph-Traversal-Engine fand 2011 statt. 2015 fand es seinen Weg in den Apache-Inkubator. Weil es sich leicht integrieren lässt, flexible Speicheroptionen aufweist und eine Permissive-Use-Lizenz besitzt, wurde TinkerPop zur bevorzugten Wahl von NoSQL-Anbietern, wenn sie ihren Produkten eine Graph-Schnittstelle hinzufügen wollten.

Nach Angaben der unabhängigen Publikation DB-Engines.com ist Neo4J bereits für etwa die Hälfte des gesamten Graph-Marktes verantwortlich. Produkte, die auf TinkerPop basieren, sind in etwa 40 Prozent des Gesamtmarktes vertreten. Die restlichen zehn Prozent verteilen sich auf über 20 verschiedene Anbieter, darunter auch bekannte wie Apache Spark, junge wie Amazon Neptune und proprietäre wie SAP HANA.

Neo4J

Neo4J verfügt über eine native Graph-Plattform. „Nativ bedeutet, dass wir die Graphdatenbank von Grund auf für das Graph-Datenmodell entwickelt haben“, erläuterte CEO Emil Eifrem, der auf seiner Kundenveranstaltung Berlin besuchte, den Unterschied zu nicht-nativen Graphdatenbanken. „Dort wird das Graph-Datenmodell über eine Adapterschicht realisiert, die auf das darunter liegende Datenmodell, egal, ob relational, JSON-basiert oder Key-Value-basiert, aufgesetzt wird.“ Dieser Ansatz sei wenig performant, nur begrenzt skalierbar und zudem fehleranfällig.

Im Unterschied dazu sei die Neo4j-Datenbank aus einem Guss, denn der Hersteller besitze ja den kompletten Technologiestapel und könne alle Komponenten für einen bestimmten Zweck optimieren, also auch für bestimmte Workloads. Zudem besitze er die Indizes, die er oder der Kunde ebenfalls zweckgebunden optimieren könnten. Die Neo4j-Plattform steht unter den Namen „Aura“ als Service in der Public Cloud bereit.

Die Abfragesprache Cypher ist mittlerweile die Standardabfragesprache für Graphen, beispielsweise auf Apache Spark. „Cypher soll das Spark-eigene Graph-Tool mit der Zeit ablösen, wobei die Cypher-Implementierung für Spark CAPS (Cypher für Apache Spark) heißen wird“, sagte Eifrem.

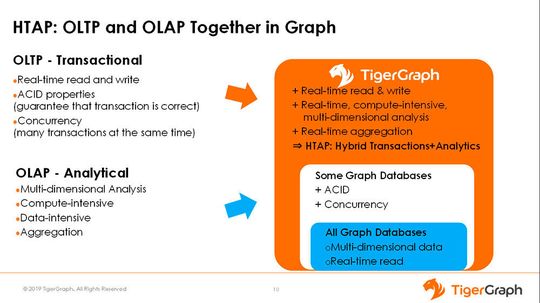

Amazon Neptune

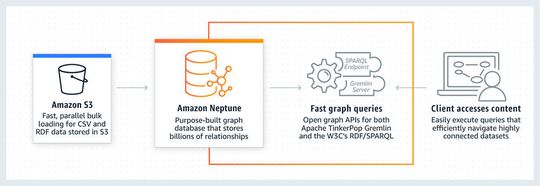

Amazon Neptune ist ein schneller, belastbarer, vollständig verwalteter Graphdatenbankservice für die Erstellung von Anwendungen, die mit stark verbundenen Datensätzen arbeiten. Der Kern ist laut Hersteller eine speziell entwickelte, hochleistungsfähige Graphdatenbank-Engine, die für die Speicherung von Milliarden von Beziehungen und die Abfrage des Graphen mit einer Latenzzeit im Millisekundenbereich optimiert ist. „Die Datenbank ist auf OLTP-Anfragen optimiert, auf sehr viele parallele Anfragen mit sehr kurzer Latenzzeit“, erläutert Michael Hanisch, Head of Technology bei Amazon Web Services (AWS) in Deutschland.

Amazon Neptune unterstützt die gängigsten Datenmodelle Property Graph und RDF von W3C sowie die zugehörigen Abfragesprachen Apache TinkerPop Gremlin und SPARQL, sodass Nutzer damit wie mit offenen APIs Abfragen erstellen können, die effizient durch hochverknüpfte Datasets navigieren.

Amazon Neptune ist für die Arbeit mit Graphdaten im Hauptspeicher optimiert, beschränkt die Datenbank aber nicht auf die Größe des Speichers. Die Größe einer Amazon-Neptune-Datenbank ist immer auf 64 Terabyte beschränkt, unabhängig von der Größe des Hauptspeichers. Der Nutzer muss zusehen, dass er seine Daten immer im Working Set hat, also in dem, was viel gelesen wird. Dafür optimiert Neptune die Lesezugriffe, die Read Queries. Deshalb muss der Nutzer je nach Bedarf nach oben oder nach unten skalieren. „Wir unterscheiden zwischen schreibendem und lesendem Zugriff“, sagt Hanisch. Die diversen Working Sets könnten je nach Anfragelasten verschieden gestaltet werden.

„Was die Kunden wollen, sind Ausfall- und Datensicherheit, Performance und angemessene Kosten pro Workload“, weiß Hanisch. „Sie wollen zudem Hochverfügbarkeit, Unternehmenskunden wollen Support und die Einhaltung von SLAs.“

Skalierbarkeit und Leistung

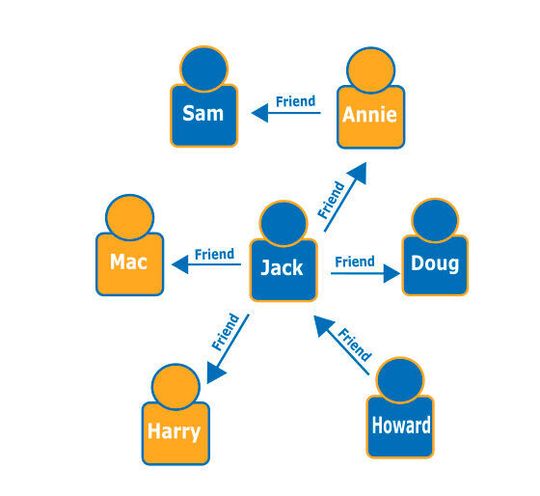

Zugleich verlangen die Kunden die Skalierbarkeit der Graphdatenbank, wenn beispielsweise ein größeres Datenbankmodell zu realisieren sei, wie etwa bei Facebook. „Da gibt es dann auch viele Verbindungen zwischen den Entitäten und Konzepten.“

Es gibt verschiedene Wege, eine ausreichende Skalierbarkeit sicherzustellen. „Man könnte im relationalen Modell beispielsweise eine ziemlich lange Tabelle erstellen, etwa für einen Kunden und seine Kontakte“, schlägt Hanisch vor. Aber bei einem Beziehungsgeflecht komme der Nutzer mit einem relationalen Modell schnell an seine Grenzen. Deshalb sei die Verwendung einer Graphdatenbank sinnvoll.

„Die Hochverfügbarkeit von Neptune wird vor allem mit Read Replicas gewährleistet“, sagt Hanisch. Diese können in verschiedene Availability Zones (AZs) platziert werden und synchronisieren ihre Daten automatisch aus dem Cluster-Volume von Amazon Neptune. „Der Lesezugriff für Queries“, so Hanisch, „erfolgt über diese Replikate, was optimal für OLTP ist, sodass die Latenz im Zehn-Millisekunden-Bereich liegt.“

Es gebe eine Master-Instanz und bis zu 15 Read-Replicas. Der schreibende Zugriff ist auf die Master-Instanz der Gesamtdatenbank begrenzt, aber der Lesezugriff lässt sich stark skalieren: „Der Nutzer kann diese Zugriffe über maximal 15 Replikate der gesamten Datenbank verteilen.“ Die Master-Instanz sei auch für die Serialisierung der Transaktionen zuständig, für die Neptune ausgelegt sei. Sie und viele Working Sets würden im Hauptspeicher gehalten, um den Durchsatz zu erhöhen und die Latenz zu reduzieren. Das Anlegen von Working Sets und ihre Optimierung erfolgen laut Hanisch automatisch.

Die Daten werden an die Replikate über den Virtual Storage Layer (VSL) von Amazon Neptune verteilt, das sogenannte Cluster-Volume. Diese logische Schicht basiert auf einem Storage-Cluster, den Neptune verwaltet. Der VSL führt ein über die Availability Zones (AZs) verteiltes Transaktions-Log, was zusätzlich zu IAM- und Key-Management die Datensicherheit erhöht. Hochverfügbarkeit und Dauerhaftigkeit der Daten seien so für die anspruchsvollen Kunden gewährleistet.

Mit einer Verteilung von Replicas über mehrere AZs hinweg lasse sich die Hochverfügbarkeit zwecks Failover maximieren. „Die Replikate“, so Hanisch, „holen sich ihre Daten natürlich zunächst aus der gleichen AZ, um die Latenzzeit zu reduzieren.“ Die Größe der Replikate hänge von der Arbeitslast ab, doch diese Größe lasse sich statisch gut definieren. Die Workload sei entscheidend, so etwa wie viele Anwendungen zugreifen können oder dürfen.

Die Leistung lässt sich analog zur Skalierbarkeit steigern. „Replicas“, so Hanisch weiter, „lassen sich auf größere EC2-Instanzen verlegen, um ihnen mehr Leistung zu verleihen: Mehr Ressourcen, mehr gleichzeitige Verbindungen, können mehr Daten im Cache vorhalten.“ Load Balancing lasse sich für alle Replikate realisieren. „Amazon Cloudwatch, das die Datenbank überwacht, liefert dazu geeignete Metriken, wie beispielsweise die CPU oder der Hauptspeicher ausgelastet sind.“

TigerGraph

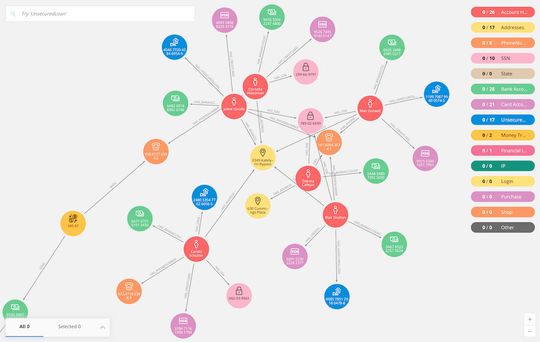

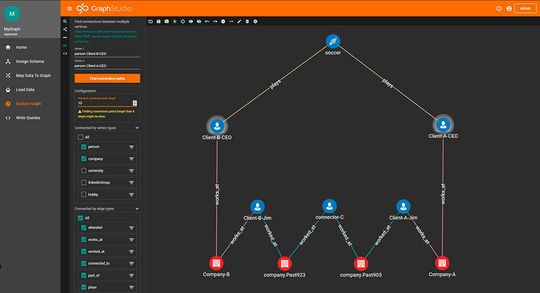

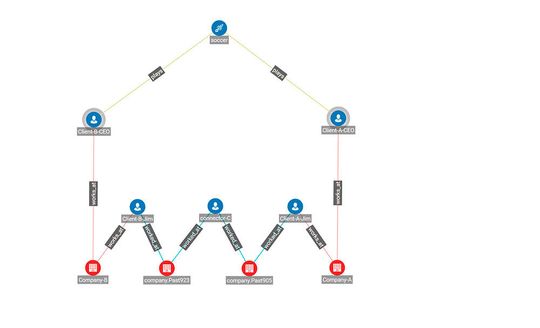

Im März 2020 wurde die Version 3.0 der Graph-Datenbank TigerGraph freigegeben. Als TigerGraph Cloud steht sie auch als Graphdatenbank-as-a-Service zur Verfügung. Die Stärken dieser Version, die über einen Visual Query Builder verfügt, sollen lineare Skalierbarkeit und vor allem Analyse sein. Mit einer „Analyse per Mausklick“ soll der Nutzer relevante Rückschlüsse aus komplexen Datenbeziehungen ziehen können, einfach durch das Bewegen der Knoten und Kanten in einem Diagramm und der Angabe der Analyseebenen.

Besonders stolz ist man TigerGraph auf die Fähigkeit, bis zu zehn Ebenen an Beziehungen untersuchen und darstellen zu können. Dafür ist ein hohes Maß an Skalierbarkeit in einer entsprechend ausgestatteten Cloud-Instanz nötig. In einer Vorführung lief TigerGraph auf AWS. Damit diese Skalierbarkeit linear wachsen kann, sind eine entsprechende Clusterverwaltung und Massive Parallel Processing notwendig, zwei Leistungsmerkmale, auf die TigerGraph Wert legt.

Im Cluster sind die Daten abgelegt und gesichert. Die nutzerdefinierte Indexierung soll Nutzer in die Lage versetzen, die Datenbankleistung für bestimmte Fragen zu verbessern – analog zum Working Set in Neptune. „Ähnlich wie der Index am Ende eines Fachbuchs enthält auch ein nutzerdefinierter oder Sekundärindex in einer Datenbank Verweise, mit denen der Nutzer direkt auf die Daten zugreifen kann, die er gerade benötigt“, so der Hersteller.

(ID:46850378)

:quality(80)/p7i.vogel.de/wcms/b5/ad/b5ade2e50671d986cabb091cc33de39f/0127234511v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2d/69/2d69b27f3f8f5f290f7ae2b3d9123b1b/0127206601v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/94/d2/94d28e3faac411c22b54d80ea354d2e3/0124559320v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a2/c7/a2c782b2b66e7b76ab3015186c26fc5a/0130623980v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cd/d6/cdd6fc25c704ffe9ab6afc24ec68725e/0130507132v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/08/b9/08b906f0ef0c5ad843b0ce1a09335985/0130533152v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/20/f4202793ccad19cb4986ef467548854a/0130864282v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/07/38/07382204cc163f3172de0a99dc5d6abf/0130936373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/c8/48c8f436d680ea980781cbd728c109c1/0129826847v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/fe/acfef93609c37a7ea61b1e3244dea967/0130620671v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/81/488147108a520bc67dadbdf1c59178c7/0129710650v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/37/e2/37e239c7ec0154c8c93688ca2554af48/0130578270v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c1/81/c1811ad769ce2c6fe9e5bfb2c8775591/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/55/b75581013900f582f2200a2d53e23359/0130382558v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bd/0a/bd0a232a32dc365e8e19c2ad5a2aeb43/0130082482v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/37/4a3731ad57c47e87cfedcd5342b9a4da/0129713569v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/fa/92fa56077ccd3ff878b6a85ce4de1d32/0130727055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f8/db/f8dbe2337659dd44bdf89efec6cfcf1a/0129529497v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/18/fe181da82b3e76596f4d461a5920a33a/0129473576v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ca/3f/ca3f194f4553759bea537346bc9e3988/0129465088v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1552300/1552323/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1644500/1644561/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1641800/1641842/original.jpg)

:fill(fff,0)/p7i.vogel.de/companies/69/98/699837ff85e16/datacore-logo-700x700px.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/b9/68b9bb61e8f14/ic-logo-black-green.png)

:quality(80)/p7i.vogel.de/wcms/76/95/7695526fc5344b1ffd5c69cb768cf27c/0128979470v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c8/49/c849e178b4f36c6f22115a343023fc2b/0127726759v1.jpeg)