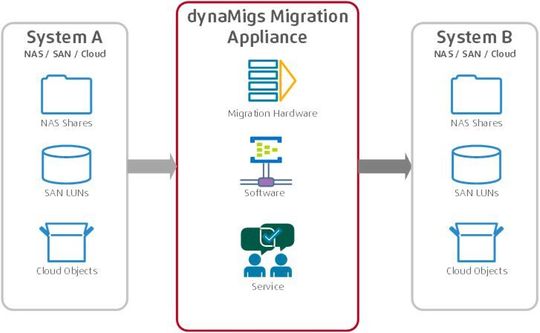

Datenmigration und -management dynaMigs: Spezialist für komplexe Umgebungen

Datenmigrationen und Datenmanagement gehören zu den herausforderndsten Aufgaben von Storage-Admins. Deshalb ist es manchmal sinnvoll, sich extern Hilfe zu holen. Die bietet dynaMigs, ein relativ junger IT-Dienstleister aus Gräfelfing. Wir sprachen mit Ralf Draeger, einem der Gründer und Gesellschafter, über Probleme bei der Datenmigration und die Automatisierung des Datenmanagements.

Anbieter zum Thema

Storage-Insider: Herr Draeger, dynaMigs hat sich auf Datenmigration und -management spezialisiert. Das sieht wie ein sehr enger Fokus aus. Wie kommt das?

Ralf Draeger, dynaMigs: Das erklärt sich aus unserer Entstehungsgeschichte. Sie beginnt mit einem riesigen Migrationsprojekt, das wir vier Gründer für EMC zu bewältigen hatten. Damals ging es darum, 1.500 NetApp-Filer auf eine EMC VNX zu migrieren. Wir haben damals das gesamte Projekt automatisiert. Damals beschlossen wir, dass wir das gewonnene Wissen nutzen könnten, um uns als Dienstleister in diesem Bereich selbständig zu machen.

Wie groß ist Ihr Unternehmen, und besteht eine Abhängigkeit zu EMC?

Draeger: Am Anfang waren es nur wir vier Gesellschafter, inzwischen sind wir ein Team von über 30 Mitarbeitern, davon 15 Festangestellte in unserem Unternehmenssitz in Gräfelfing. Und von EMC sind wir nicht abhängig, auch wenn wir von NetApp und EMC bei den Managed-Service-Kunden des Unternehmens Migrationaufgaben erledigen. Das haben wir aber auch schon beispielsweise in Umgebungen mit Huawei-Storage gemacht.

Wen adressieren Sie?

Draeger: Zunächst einmal sehr große Storage- respektive Migrationsprojekte mit mehr als zehn Petabyte, wie sie sich vielleicht bei einigen Hundert Unternehmen in Deutschland finden. Inzwischen haben aber nicht mehr nur Großunternehmen solche Datenmassen, sondern zunehmend auch Mittelständler mit einem datenintensiven Geschäftsmodell. Außerdem sind wir auf Umgebungen fokussiert, die NFS und CIFS als Übertragungsprotokolle verwenden.

Man sollte meinen, dass so große Unternehmen genug Manpower haben, um Migrationsprojekte selbst abzuwickeln …

Draeger: Gerade nicht. Es fehlt oft die Zeit dazu, deshalb wird Storage häufig als Managed Service bezogen. Da kommen wir ins Spiel, und wir arbeiten oft wiederum mit externen Offshore-Dienstleistern, die unser Auftraggeber oder der Kunde ausgewählt haben und die die einzelnen Datenpaketmigrationen tatsächlich durchführen.

Wieso das?

Draeger: Die Migration von A nach B erfordert in File-Umgebungen noch immer, dass jede Datei angefasst wird. Das bedeutet: Man braucht ein Wartungsfenster, in dem die Systeme abgeschaltet sind, und das befindet sich meist nachts und am Wochenende. Die Feiertags- und Nachtzuschläge machen so riesige Projekte hierzulande nahezu unbezahlbar. Man braucht billigere Mitarbeiter, weil die Kunden auf günstigere Preise drängen. Das bedeutet: Offshore. Wir übernehmen bei kleinen Projekten diese Aufgaben selbst, aber die Kunden, die das betrifft, sind auch bereit, unsere Dienstleistung entsprechend zu honorieren.

Was sind die größten Herausforderungen bei Datenmigrationen?

Draeger: Bei großen Migrationsprojekten steht an erster Stelle die Organisation und Koordination, das ist dann bei Projekten mit Offshore-Dienstleistern auch eine wichtige Aufgabe, die wir im Rahmen unseres Change-Managements übernehmen. Schließlich braucht man Wartungsfenster, die zu beschaffen in den Produktionsumgebungen großer Unternehmen nicht einfach ist.

Und auf der technischen Seite?

Draeger: Man muss verstehen, dass den Checks der Migrationstools selbst grundsätzlich zu misstrauen ist. Sie sind einfach nicht gut genug. Es braucht eine externe Lösung, die überprüft, ob das Abgeschickte auch tatsächlich genauso auf der Gegenseite angekommen ist. Und eine solche Lösung bieten wir.

Können Sie Beispiele nennen?

Draeger: Wir haben Fälle erlebt, bei denen durch bestimmte Mechanismen von Excel-Dateien nur noch der Anfang korrekt kopiert, der Rest aber mit Nullen aufgefüllt wurde bis zur vollen Größe. Es sah aus, als wären die Dateien da, aber man konnte nicht mehr mit ihnen arbeiten. In einem anderen Fall kamen am Ziel bei mehr als 100 Dateien plötzlich weniger Dateien an, als abgeschickt wurden. Es handelte sich um einen Fehler, der durchaus öfter vorkam und den unser Tool entdeckte. Inzwischen gibt es dafür ein Hotfix. Solche Fehler findet man mit den Migrationstools der Anbieter nicht; da muss feineres Werkzeug ran, und das bedeutet auch viel Handarbeit beim Überprüfen der einzelnen Kopiervorgänge. Das ist unser Job.

Welche Fehlerquellen und Herausforderungen gibt es bei der Migration noch?

Draeger: Das fängt damit an, dass Unternehmen in der Regel nur alle drei bis vier Jahre migrieren. Damit fehlt tiefes Know-how und Routine. Auch die Hersteller und Serviceanbieter haben keine Manpower für Migrationen. Dann stehen in vielen Umgebungen unzählige unterschiedliche Clients, bei denen jeweils Details zu berücksichtigen sind bis hin zum Umgang mit Umlauten. Besonders wichtig ist, wann man Apps stoppt, Mounts durchführt und so weiter.

Wie gehen Sie bei Projekten vor?

Draeger: Wir analysieren mit unserem Tool zuerst die zu migrierenden Datenbestände und ihre Quellen, dann die Ziele. Dann bauen wir digitale Modelle der einzelnen Komponenten, etwa Zielserver, Zielfilesystem oder Q-Tree. Dafür haben wir Software-Module entwickelt, die wir nur anpassen und zusammenstecken müssen, so dass eine weitgehend automatisierte Lösung dafür entsteht, die Quellen auf den Zielen abzubilden. Für die Migration nutzen wir bis zu 100 ferngesteuerte Unix- und Windows-Systeme parallel als Migrationsrechner. Wir bilden sogenannte „Migrations-Atome“, etwa Tree-Quotas, mappen Quellen und Ziele und definieren entsprechende Copy-Jobs. Wir bündeln so viele Quelle-Ziel-Beziehungen wie möglich zu einem Umschaltpaket und managen die dafür genutzte Bandbreite. Dann wird ein Initialjob gebaut und anschließend nur noch inkrementell von Quelle an Ziel kopiert. Anschließend muss ein Change definiert werden, dessen Zeitpunkt mit den Verantwortlichen für Server, Applikationen, Betriebssysteme abzustimmen ist. Im definierten Offline-Fenster findet der finale Kopierlauf statt, und es werden Snapshots gezogen. Anschließend folgt der Test auf Funktionsfähigkeit, und die Daten werden verifiziert sowie gegebenenfalls bereinigt. Das war’s.

Die Cloud ist inzwischen ein Teil der Standardinfrastruktur in vielen Unternehmen – laut IDC haben 95 Prozent der Firmen inzwischen eine Cloud-Strategie. Welche Erfahrungen haben Sie mit Datenmigrationen in die Cloud gesammelt?

Draeger: Eine Strategie ja, aber was steckt tatsächlich dahinter? Die Cloud-Umsetzung ist trotz gewaltiger Zahlen der Marktforscher in Deutschland eher zögerlich, besonders wenn es um betriebswichtige Daten geht. Wir sehen aber eine Tendenz, Cold Data auszulagern, etwa mit Komprise, und über Stubs darauf zuzugreifen. Unsere Kunden sind eher zögerlich, Daten in die Cloud zu migrieren. Wir konnten aber schon Erfahrungen bei der Migration in Office-365-Umgebungen sammeln. Der Service stellt hohe Anforderungen an eine saubere Rechte- und Namensvergabe bei den Daten. Unser Tool analysiert die Daten im Vorfeld daraufhin, so dass Fehler diesbezüglich vor der Migration korrigiert werden können.

:quality(80)/images.vogel.de/vogelonline/bdb/1853100/1853138/original.jpg)

Merkmale und Funktionen eines Storage-Managements

Alle Speicher im Griff

Es gibt einige weitere neue Themen im Bereich Daten und Storage, die derzeit wichtiger werden und sich vom klassischen Umfeld unterscheiden: Cloud, Edge, Data-Lakes und Container. Inwieweit waren Sie hier bisher aktiv?

Draeger: Mit Data-Lakes und Edge hatten wir bislang noch nichts zu tun. Und was Container angeht, werden sie im NAS-Umfeld mit den virtuellen Maschinen, auf denen sie liegen, migriert. Bei SAN- und iSCSI-orientierten Block-Umgebungen kann man die Daten über das Backend migrieren. Einen ESX-Datastore kann man einfach mit vMotion umziehen, ohne dass der Betrieb unterbrochen wird. Man legt einen zweiten Datastore an, und ESX macht den Rest allein.

Ihr Unternehmen sieht sich als Spezialist für Datenmigration und -management. Was tut sich im zweitgenannten Bereich, dem Datenmanagement?

Draeger: Beim Datenmanagement sehen wir noch gewaltigen Automatisierungsbedarf. Wir gehen davon aus, dass die Mehrheit aller Firmen innerhalb der nächsten Jahre Software-basierte Datenverwaltung einführen wird. Denn es wird nicht länger möglich sein, große Datenmengen manuell optimal zu speichern. Durch Software-basiertes Datenmanagement erreichen Firmen mehr Effizienz in der Datenverwaltung und bessere Kapazitätsauslastungen zwischen den Systemen On-Premises und in der Cloud. Hier gibt es noch viel Kosteneinsparpotential bei der Datenspeicherung.

Vielen Dank für das Interview, Herr Draeger!

(ID:47730658)

:quality(80)/p7i.vogel.de/wcms/b5/ad/b5ade2e50671d986cabb091cc33de39f/0127234511v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2d/69/2d69b27f3f8f5f290f7ae2b3d9123b1b/0127206601v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/94/d2/94d28e3faac411c22b54d80ea354d2e3/0124559320v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cd/d6/cdd6fc25c704ffe9ab6afc24ec68725e/0130507132v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/08/b9/08b906f0ef0c5ad843b0ce1a09335985/0130533152v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/fa/92fa56077ccd3ff878b6a85ce4de1d32/0130727055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/07/38/07382204cc163f3172de0a99dc5d6abf/0130936373v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/31/2c310e263bd5f3746b66eb0b0eb711dd/0130707872v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/86/06/86068cee815dbb389250a7655f0d55d3/0130597756v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/c8/48c8f436d680ea980781cbd728c109c1/0129826847v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/fe/acfef93609c37a7ea61b1e3244dea967/0130620671v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/81/488147108a520bc67dadbdf1c59178c7/0129710650v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c1/81/c1811ad769ce2c6fe9e5bfb2c8775591/0130016264v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/ff/68ff1f86c3747efa69a932a2b29e2e6f/0130912670v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/55/b75581013900f582f2200a2d53e23359/0130382558v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bd/0a/bd0a232a32dc365e8e19c2ad5a2aeb43/0130082482v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/37/4a3731ad57c47e87cfedcd5342b9a4da/0129713569v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/2f/022f4cf56715e098d0cfb1c97812038e/0130515238v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/3e/243e149198de7d0ac862c3edc694bfe4/0130490930v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f8/db/f8dbe2337659dd44bdf89efec6cfcf1a/0129529497v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/18/fe181da82b3e76596f4d461a5920a33a/0129473576v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ca/3f/ca3f194f4553759bea537346bc9e3988/0129465088v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1552300/1552323/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1644500/1644561/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1641800/1641842/original.jpg)

:fill(fff,0)/p7i.vogel.de/companies/69/98/699837ff85e16/datacore-logo-700x700px.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/db/63dbd1915b7af/2023-fastlta-logo-square-positive.jpeg)

:quality(80)/p7i.vogel.de/wcms/25/84/2584b7e9528508550d1ffce8185d3173/0125601832v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/87/0e874fb5b3a0ed0a404d6dfcf838e25e/0127775105v1.jpeg)